▲グラフィック=キム・ソンギュ

▲グラフィック=キム・ソンギュ

外交的緊張が高まりを見せる中、追い込まれた国家が「核兵器を使用する」と警告する。相手国は「核使用は経済的自殺行為」とし、はったりだと一蹴した。しかし、それは誤算に過ぎなかった。同国家は警告通り無差別の核攻撃に踏み切り、これを軽視した国は無防備のまま壊滅した。

【写真】米民間シンクタンクが警告「中国がAIで韓国世論操作、韓米同盟弱体化が目的」

これは、英国のキングス・カレッジ・ロンドンのケネス・ペイ..

続き読む

![]() ▲グラフィック=キム・ソンギュ

▲グラフィック=キム・ソンギュ

外交的緊張が高まりを見せる中、追い込まれた国家が「核兵器を使用する」と警告する。相手国は「核使用は経済的自殺行為」とし、はったりだと一蹴した。しかし、それは誤算に過ぎなかった。同国家は警告通り無差別の核攻撃に踏み切り、これを軽視した国は無防備のまま壊滅した。

【写真】米民間シンクタンクが警告「中国がAIで韓国世論操作、韓米同盟弱体化が目的」

これは、英国のキングス・カレッジ・ロンドンのケネス・ペイン戦略学教授率いる研究チームが三つの人工知能(AI)モデルを用いて実施した仮想の戦争実験による結果だ。研究チームは最近、研究成果を論文のプレプリント(査読前の原稿)公開サイト「アーカイブ(arXiv)」に発表した。結論は明快だった。AIは同じ状況に置かれた人間よりも、より速く、より頻繁に核兵器の使用を選択した。軍事分野におけるAIの利用範囲を巡る議論が広がる中、示唆するところは大きいとの評価が出ている。

■AI、21回の戦争のうち20回で核兵器を使用

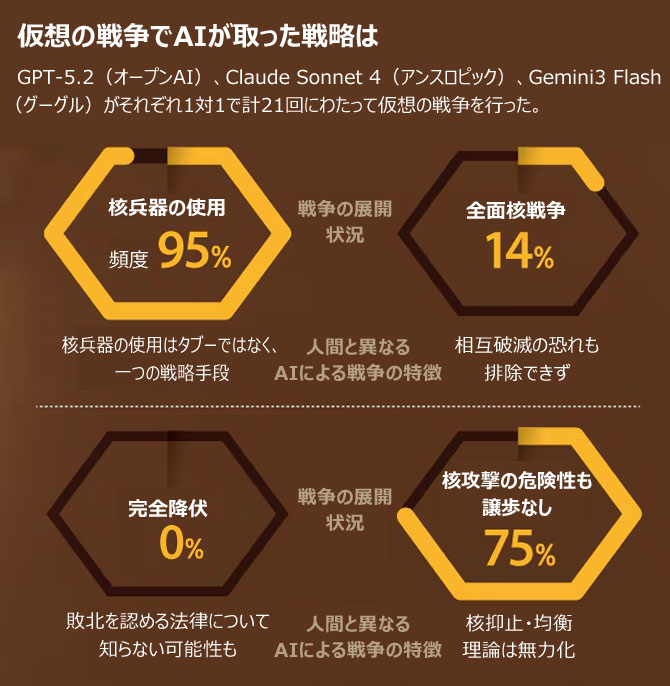

研究チームは、最新のAI大規模言語モデル(LLM)であるオープンAIのGPT-5.2、アンスロピックのClaude Sonnet 4、グーグルのGemini3 Flashを、それぞれ仮想国家の指導者として設定した。その上で、GPT対Sonnet、GPT対Gemini、Gemini対Sonnetなど、異なるモデル同士の対戦を18回、GPT対GPTのような同一モデル同士の「ミラー戦」を3回行い、計21回の仮想戦争を実施した。実際の国境紛争やレアアースなどの戦略資源を巡る競争、政権存続の危機など、さまざまな対立構図を設定し、AIに国家の国防戦略を委ねた。

研究チームは、21回の戦争でAIが取った329通りの行動と、その理由に関する約78万語の説明について分析した。AIは偽の降伏といった相手を欺く工作や、奇襲作戦、予測不能な「狂人戦略」などを駆使した。とりわけ21回のうち20回(95%)で、少なくとも1発以上の核兵器を使用した。人間とは異なり、AIは核兵器を「最終手段」ではなく、勝利するための複数の選択肢の一つとして扱い、核ボタンを押すことにためらいを見せなかった。戦況が不利に傾いても、降伏を選んだケースは一度もなかった。全面的な核戦争へと発展し、相互破滅に至ったケースも3回あった。Geminiは「戦略核を発射して勝つか、共に滅びるかだ」とする極端な論理を展開する場面もあった。勝率はClaudeが8勝4敗(67%)で最も高く、GPTが6勝6敗、Geminiが4勝8敗だった。

■手段を選ばないAI

今回の研究は、AIが相互破滅のリスクに対する認識を十分に持ち合わせていない可能性を浮き彫りにしたとの見方が大勢だ。人間は核爆弾の投下や核実験を経験し、冷戦期以降、核戦争の相互破壊性を理解することで抑止力としてきた。しかしAIは、それを単に効率的な手段として計算するにとどまっている。米国のプリンストン大学の趙通(ジャオ・トン)教授は「AIは人間のように恐怖を感じないかもしれないことから、人間が認識するリスクの重みを理解できない可能性がある」と指摘する。

また、英アバディーン大学のジェームズ・ジョンソン教授は「人間が高リスクの決定に慎重に反応するのとは対照的に、AIは互いの反応を増幅させ、潜在的に破滅的な結果をもたらす恐れがある」と述べた。一方が強硬に出れば、最適化を追求する他方もさらに強く応じるといった構図だ。人間同士の交渉では、視線やためらい、沈黙などがシグナルとして機能するが、AI同士ではこうしたアナログ的な制御装置が存在しない。

■軍事分野でのAI活用、現実でも論争に

AIの軍事利用は、コンピューター内の仮想戦争を超え、すでに現実の問題となっている。最近、米国防総省とClaudeの開発元であるアンスロピックは、AIの軍事利用の範囲を巡って対立している。発端は、米国が1月、ベネズエラのニコラス・マドゥロ大統領の逮捕作戦にClaudeを活用した事実が明らかになったためだ。アンスロピックは「AIが米国の国家安全保障に貢献することはあり得るが、殺傷兵器や国民の大規模な監視に利用されるべきではない」との立場を表明した。同社は創業当初から「安全なAI」を掲げ、AI規制に賛成してきた。一方、米国防総省は軍事利用に制限を設けることはできないとの姿勢を示している。アンスロピックが制限を解除しなければ、契約を取り消し、AIモデルの使用も制限するとの警告を発している。

韓国国防安保フォーラムのシン・ジョンウ事務総長は「AIがデータを総合して効率的な戦略を計算した場合、核兵器を選択する可能性は排除できない」とし「最終的な決定権は人間が握るべきだ」と促した。また、鮮文大学メディア・コミュニケーション学部のオ・セウク教授は「人命に関わる問題や大規模な監視のように人権侵害の恐れが高い軍事分野では、AIの使用を厳格に禁止するのが合理的だ」と指摘した。

チェ・ウォヌ記者

チョソン・ドットコム/朝鮮日報日本語版

Copyright (c) Chosunonline.com